Le dernier ouvrage de Dominique Boullier traite de la question des “propagations”, dans une approche en partie structuraliste qui est celle de l’acteur réseau, il indique la place que ce concept de “propagation” recoupe et recouvre dans l’étude du vivant, dans le domaine des sciences sociales, et bien sûr dans l’analyse des réseaux socio-numériques.

Je veux vous parler ici d’un concept qui me semble (en partie) miroir de celui de Dominique Boullier, et que je choisis de nommer “partitions”. La partition est prise ici au sens de division, de partage. Mais aussi dans son acceptation musicale. La partition c’est celle qui s’opère “entre” les différents environnements et médias sociaux auxquels nous avons accès. Autant de partitions qui sur les plans sociologiques, cognitifs, attentionnels et générationnels, sont de plus en plus actives et déterminantes.

Au sein de médias sociaux participant de mêmes logiques d’usage, on observe, pour plein de raisons, une augmentation des partitions qui s’opèrent avec de nouveaux entrants pour une fois semblant significatifs sur le secteur (ou en tout cas en voie de l’être). Ainsi nos usages sur Twitter “partitionnent” actuellement avec nos usages sur Mastodon et désormais, progressivement, sur BlueSky et désormais Threads.

Captures d’écran de mes comptes Bluesky, Threads, Mastodon et Twitter.

Quatre (ré)partitions.

Ce partage, cette division le plus souvent entre 4 réseaux aux modes opératoires sensiblement équivalents mais se différenciant notamment par la sociologie de leurs publics et par leurs enjeux d’administration, de modération et d’organisation (centralisée ou fédérée), nous astreint à de nouvelles partitions subséquentes : si nous ne quittons pas l’un pour l’autre, nous nous astreignons à entretenir et à lire deux, trois ou quatre partitions (au sens musical cette fois) différentes ; ce que nous disons dans l’un et l’autre ne percole et ne se transmet pas de la même manière, ne suscite pas les mêmes échos dans l’autre ou dans les autres.

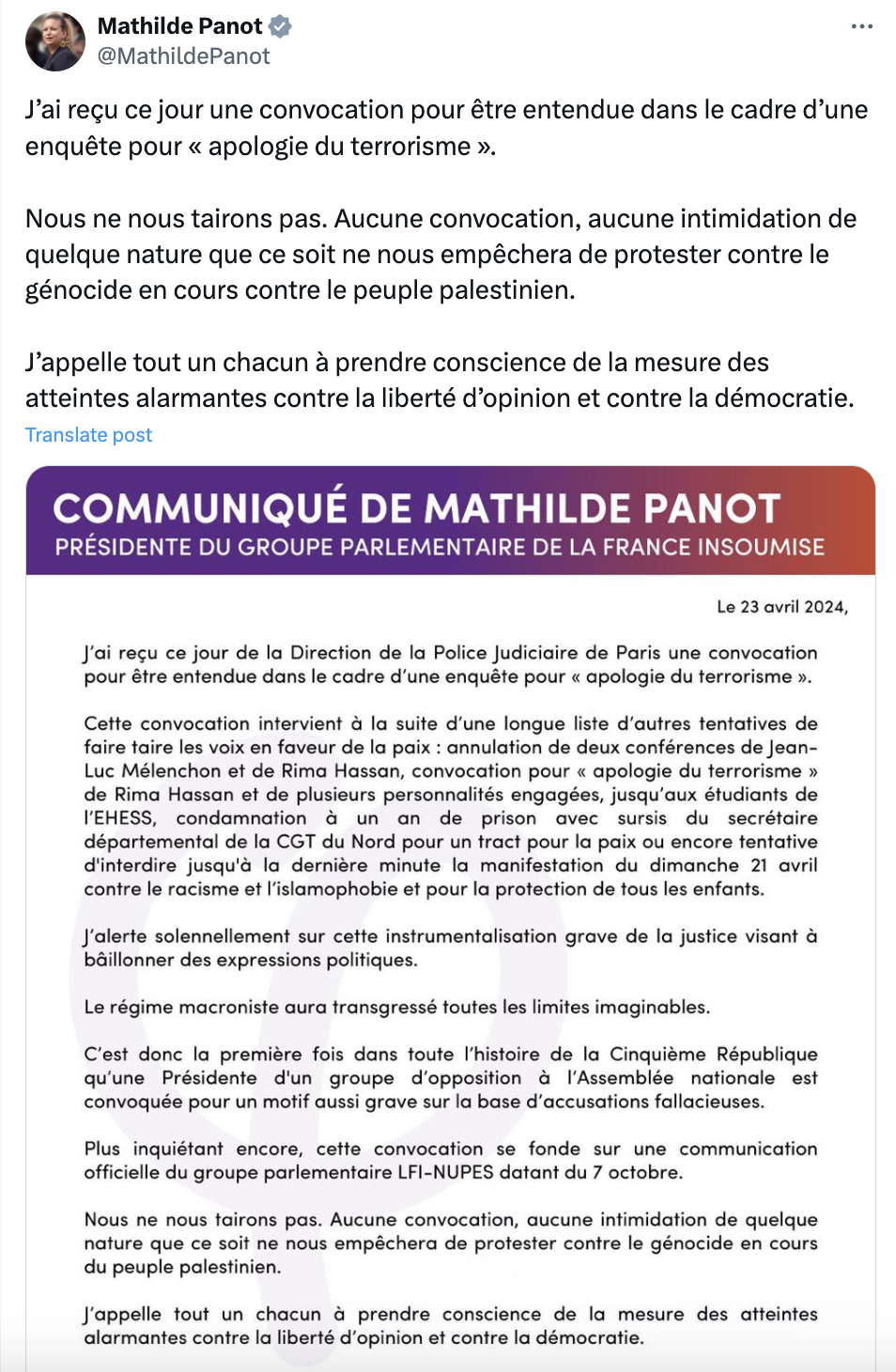

Au sein même de Twitter / X ou de ses subséquents, le fil d’info partitionne entre les gens que l’on suit et les contenus que l’algorithme choisit de nous recommander. Et la partition de Twitter depuis le rachat par Elon Musk est devenu un calvaire pour les interprètes que nous sommes. Si la partition “partitionne” entre le fil des gens que nous suivons (“following”) et le fil personnalisé (“for you”), beaucoup des gens que nous suivons n’apparaissent étrangement que dans le fil personnalisé, et réciproquement des gens que nous ne suivons pas font irruption permanente dans l’onglet supposément réservé aux gens que nous suivons. Partition illisible. Cacophonie plutôt que polyphonie. La partition “partitionne” encore entre les désormais comptes certifiés et les autres. Les premiers étant, conformément à la promesse de Musk, sur-visibilisés et rendant l’ensemble de nos fils (“following” comme “for you”) totalement criblés d’interventions non sollicitées.

Et puis il y a la partition des solistes que nous sommes. Jusqu’au rachat par Elon Musk il y avait sinon une causalité, à tout le moins une corrélation entre le nombre de nos abonné.e.s et la volumétrie des interactions (vues, partages, retweets, etc.) générées sous chacun de nos Tweets. Cela pouvait d’ailleurs devenir un fardeau ou une forme de nuisance, et cela m’avait conduit à fermer mon premier compte Twitter lorsque celui-ci avait atteint la barre des 10 000 abonné.e.s (j’avais également proposé un bilan de cette fermeture). Depuis le passage à X, depuis l’arrivée des comptes certifiés payants, depuis les différentes manipulations et partitions opérées par Musk, nous sommes nombreux et nombreuses à disposer de comptes “importants” (10 000 followers ou parfois beaucoup plus) et à constater que le niveau “d’engagement” de nos tweets (c’est à dire à la fois la visibilité et donc les réactions – partages, commentaires qu’ils suscitent) est le plus souvent quasi-nulle. Ce qui pourrait n’être qu’anodin mais qui fait que lorsque nous tentons de défendre, dans ce média, un certain nombre de thèses ou de causes, nous nous trouvons invisibilisé.e.s du simple fait de notre absence de compte payant. Ce qui peut entraîner aussi la tentation de publier toujours davantage et de reprendre toujours plus les sujets les plus visibles afin de faire exister un peu notre voix dans ce réseau. Pour reprendre l’image du musicien dans l’orchestre, c’est comme si le son de son instrument n’existait plus et ce quelque soit le volume ou le tempo avec lequel il en joue.

X partitionne entre une poignée de Power Users (payants) et une foule de Shadow Users dont beaucoup ne sont encore là que par la lassitude de l’habitude.

La partition de Twitter / X est donc devenue illisible et cacophonique du fait des partitions structurelles installées par son propriétaire. “Ces” autant que “ses” partitions, condamnent un certain type de propagations.

Que faire de / dans ces partitions ? Des classes.

Le dernier ouvrage de Cagé et Piketty, “Une histoire du conflit politique“, met l’accent, comme principal facteur explicatif du vote et de nos choix et ressentis politiques, la notion de classe géo-sociale définie comme suit :

Ce qu’on appelle la classe géo-sociale, est un mélange de classes sociales au sens classique (la richesse, la propriété..), mais aussi l’inscription dans un tissu territorial et productif. Pour une même richesse, pour un même revenu, ce n’est pas pareil de vivre dans une métropole, ou de vivre dans un village. (Source)

Cagé et Piketty reprennent en le modifiant légèrement et en l’inscrivant dans le champ politique, le concept que Bruno Latour avait proposé en 2021 dans le cadre d’une analyse écologique et anthropologique :

“Alors qu’à la fin du siècle dernier, on pensait que les classes avaient disparu, elles ont été au contraire rematérialisées d’une manière extrêmement visible par le Covid. Tout le monde s’est aperçu des relations de classe: les gens qui meurent en fonction de la “race”, ceux qui doivent assurer les livraisons de biens et services essentiels et qui sont plus exposés au virus, etc.“. Mais il n’y voit pas la raison d’un retour au marxisme: “On s’aperçoit que les classes qu’on appelait des classes sociales ont toujours été des classes géo-sociales. Cela a toujours été des questions d’occupation de territoires, et de déplacements“. (Source)

Je veux ajouter ici une autre notion, probablement la plus puissante pour comprendre les agencements tant industriels qu’énonciatifs, économiques et politiques qui travaillent et constituent nos environnements numériques, celle de “classe vectorialiste” théorisée par Wark McKenzie :

“Ici, dans le monde surdéveloppé, la bourgeoisie est morte. Elle a cessé de régir et de gouverner. Le pouvoir est aux mains de ce que j’ai appelé la classe vectorialiste. Alors que la vieille classe dominante contrôlait les moyens de production, la nouvelle classe dominante éprouve un intérêt limité pour les conditions matérielles de la production, pour les mines, hauts fourneaux et chaînes de montage. Son pouvoir ne repose pas sur la propriété de ces choses, mais sur le contrôle de la logistique, sur la manière dont elles sont gérées. Le pouvoir vectoriel présente deux aspects, intensif et extensif. Le vecteur intensif est le pouvoir de calcul. C’est le pouvoir de modéliser et simuler. C’est le pouvoir de surveiller et calculer. Et c’est aussi le pouvoir de jouer avec l’information, de la transformer en récit et poésie. Le vecteur extensif est le pouvoir de déplacer l’information d’un endroit à un autre. C’est le pouvoir de déplacer et combiner chaque chose avec toute autre chose en tant que ressource. Encore une fois, ce pouvoir n’a pas uniquement un aspect rationnel, mais aussi poétique.” Wark McKenzie, Degoutin Christophe, « Nouvelles stratégies de la classe vectorialiste », Multitudes, 2013/3 (n° 54), p. 191-198.

Le résultat de tout cela c’est un alignement et un nombre de fractures. Fractures au moment des Gilets Jaunes par exemple puisque la classe vectorialiste au pouvoir avait oublié les considérations géo-sociales de toute une classe qui s’est fait loisir et grande lutte de les lui rappeler.

Des fractures donc, mais un alignement également. Car il s’agit, comme Facebook l’avait d’ailleurs fait au moment de l’explosion du mouvement des Gilets Jaunes, de remettre l’accent, au sein du fil d’information, sur des paramètres géo-sociaux : on verrait davantage d’informations de gens dont on était proche géographiquement.

Il est, j’en suis convaincu par plus de 20 ans d’analyses, de lectures et d’observation participante, deux horizons et deux essences de ce que l’on nomme “le” numérique, depuis les débuts du Web (et même avant) jusqu’aux actuels médias sociaux.

Le premier horizon, la première essence, est celle qui parvient à s’abstraire des classes géo-sociales pour proposer, à l’échelle de communautés toujours traversées de déterminismes, des ponts et des liens. Ces arbitraires et ces tectoniques stochastiques ne peuvent agir qu’à l’abri ou dans l’ombre d’algorithmes qui doivent d’abord s’efforcer de cartographier plutôt que de hiérarchiser et d’arbitrer. Et ces arbitraires féconds ne s’accommodent que très peu ou très mal de gigantisme.

Le second horizon, la deuxième essence, est celle qui partitionne donc à outrance en s’appuyant sur la calculabilité et la prédictibilité de ces classes géo-sociales situées. N’oublions jamais que le web comme les réseaux sociaux sont avant tout des graphes. Des arrêtes et des sommets. Que chaque page ou que chaque profil est un sommet relié aux autres par autant d’arrêtes. Et que la mise en relation et en lien est avant tout affaire algorithmique de calcul de distance et des choix de nous faire voir, d’abord, ou mieux, ou davantage, des proximités qui auront été choisies parce que les plus susceptibles de générer de l’interaction et donc de l’attention, et donc possiblement des bénéfices.

Mais l’on voit aujourd’hui s’imposer un troisième horizon. Qui prend prétexte des débats et des faits les plus saillants et correspondant le plus aux valeurs déterministes de viralité (capacité à susciter l’indignation ou la colère, affirmations partisanes, oubli du contexte, etc.) pour établir des ponts et des liens visant à coaliser autant qu’à coaguler des classes géo-sociales initialement distantes et d’autres initialement absentes de ce débat là. C’est très exactement ce à quoi concourt l’algorithme de “X” qui sur-visibilise les comptes payants et les propos les plus polémiques tout en sous-dimensionnant les équipes dédiées à la modération.

Une politique de territoires sociaux préoccupés, et préoccupants.

Pendant longtemps c’est la doctrine Thatchérienne du “il n’y a pas d’alternative” (There Is No Alternative, abrégé TINA) qui s’appliqua. Il n’y avait pas, ni en volume, ni en nombre, ni en infrastructure, ni en concentration de population, d’alternative à Facebook, à Youtube, à Twitter, à Instagram, etc. Et lorsque quelques tentatives d’alternatives naissaient, avec la possibilité d’une alternance, elles s’effondraient aussitôt (qui se souvient encore de Diaspora ?) ou étaient aussitôt rachetées, phagocytées, absorbées. Et puis.

Et puis nous passâmes à un monde où tout à la fois en raison de faits démographiques (vieillissement des primo-utilisateurs et utilisatrices, nécessité d’occuper des espaces générationnellement homogènes correspondant à des pratiques générationnellement situées), sociologiques (recherche de plateformes ou de groupes ou d’espaces sociologiquement homogènes ou semblables), politiques (en lien avec les prises de position ou l’absence de prises de position de leurs propriétaires), et médiatiques (les affaires et révélations de lanceurs et lanceuses d’alerte sur différentes pratiques abusives ou cyniques) nous disposons de plateformes structurellement différentes pour des usages en apparence semblables ou proches. Il y a des alternatives. There Are Some Alternatives. De TINA à TASA. Mais à l’image de l’offre politique actuelle en France comme dans plein de pays du monde, ces alternatives ne favorisent aucune alternance mais tout au contraire ancrent des mouvements de renforcements. Renforcements des usages, de leur base sociologique, générationnelle, culturelle aussi. Les nouvelles classes géo-sociales d’un web essentiellement fait de médias sociaux essentiellement hyper-territorialisés.

D’une économie de l’attention à une politique de l’occupation. Le coeur de l’économie du web depuis sa massification (c’est à dire depuis le début des années 2000) est celui théorisé bien avant le web par Herbert Simon : celui d’une économie de l’attention. Dans cette économie, l’information est en abondance et fixe en miroir notre attention comme une ressource rare, difficile à capter et à orienter, et donc “chère”. Les effets de propagation, consubstantiels de tous les âges du web, sont l’une des clés et l’une des principales recettes de cette économie de l’attention. Il apparaît aujourd’hui, tant dans la déclinaison des plateformes web de médias sociaux, que dans les usages massifs et “détachables” du web que sont les applications, que nombre de ces propagations sont désormais empêchées, entravées, impossibles à jouer ou à orchestrer. C’est la fin d’un mouvement amorcé il y a bien longtemps de cela, lorsque comme je l’avais écrit, documenté et expliqué dès 2010, le Like tuera le lien.

Ce pourrait être paradoxalement une bonne nouvelle si l’on considère que nombre de ces propagations ne visaient depuis quelques années qu’à faire davantage circuler des propos complotistes, haineux, ou plus trivialement inessentiels. En effet, les partitions entre non plus un seul mais désormais quatre médias sociaux semblables à Twitter / X pourraient un jour (mais quand … ?) entraîner mécaniquement un division par 4 des audiences et de la portée de tels propos. Mais ce serait oublier que l’économie de l’attention et des propagations sur laquelle le web des années 2010 s’est construit s’est alignée sur les mêmes effets de partitions et de propagations au sein d’un paysage médiatique global souvent bien plus massif et donc efficace en termes d’audiences captives.

La polarisation et la radicalisation du débat public ne sont pas le résultat ou la faute originelle du web et des médias sociaux mais le produit d’une société de médias qui tiennent des lignes éditoriales comme autant de remparts et de soliloques. La ligne éditoriale d’extrême-droite assumée de l’essentiel des médias possédés (au double sens du terme) par les délires obsessionnels compulsifs de Vincent Bolloré sont le gouffre dont les médias sociaux ne sont que le goître visible. Je l’ai déjà à de nombreuses reprises écrit et documenté, le plus récemment dans cet article pour AOC republié pour archivage sur Affordance :

Le problème de Twitter / X aujourd’hui, comme celui de Facebook, d’Instagram, de TikTok, de Snapchat et d’autres plateformes numériques n’est plus réductible à la seule question de leurs déterminismes algorithmiques. Il doit être réfléchi à la hauteur de l’ensemble de ce que j’appelle leurs architectures techniques toxiques, c’est à dire en partie, mais en partie seulement, la question algorithmique ; mais également le maillage de ces espaces d’expression avec d’autres espaces sociaux et médiatiques et la manière dont ils s’entremêlent ; mais aussi avec l’ensemble des secteurs dans lesquels ces plateformes opèrent (qui pour la majorité d’entre elles sont loin d’être réductibles au seul secteur de la tech) avec tout l’impact et les influences économiques et politiques que cela mobilise ; et enfin en regardant ces plateformes et médias comme la partie visible d’infrastructures extractivistes bien plus vastes et plus massives dans lesquelles le “média social” constitue de plus en plus une forme de leurre stratégique qui tend à gommer ou à dissimuler les matrices de pouvoir dont elles se nourrissent et qu’elles orchestrent.

Le monde informationnel et culturel dans lequel nous entrons est une matrice de dispositifs médiatiques presqu’uniquement au service d’intérêts privés dans lesquels l’idéologie précède l’économie. Ces intérêts bâtissent un monde dans lequel la force des idées qu’ils estiment dignes de propagations est non seulement compatible avec un certain nombre de partitions (d’audience, d’attention) mais aussi un monde dans lequel ces partitions vont venir optimiser les propagations choisies, leur donnant davantage de force et d’inertie dans l’opinion, selon le double vieux principe de l’effet de simple exposition et de la fenêtre d’Overton.

Comme l’écrivait Bruno Latour “Cela a toujours été des questions d’occupation de territoires, et de déplacements.” La tectonique actuelle des médias sociaux n’est faite que de territoires “occupés”. Je défendais d’ailleurs depuis 2015 (notamment dans cet article et dans cette présentation) l’idée du passage d’une économie de l’attention à une économie de l’occupation. L’une des grandes questions qui se pose sur leur avenir et qu’ils nous adressent en miroir, est celle de la nature de nos occupations comme cristallisation possible de tout ou partie de nos préoccupations. Nous ne nous occupons bien que de ce qui nous préoccupe. En dehors de nos passions intimes, la définition du périmètre de ces préoccupations est laissée à la hiérarchisation éditoriale et aux parti-pris algorithmiques qui sont une autre fabrique du consentement, qui est aussi un con-sentiment si vous m’autorisez le néologisme. Des territoires occupés donc. L’autre grande question est celle des déplacements. Précisément de ce que Dominique Boullier nomme les propagations : jusqu’à quel point ces déplacements et ces propagations demeurent possibles dans des espaces toujours plus (pré-)occupés autour de partitions toujours plus exclusives et excluantes ? Et le cas échéant, que fabriquent alors ces propagations sinon des boucles de ressentiment emplies de biais de confirmation ?

Il y a toujours eu un récit, une mise en discours anthropologique des espaces numériques. Et dans ce récit, fait de “toiles”, de “liens” et de “navigateurs”, l’idée que rien dans ce monde ne nous était possiblement inconnaissable ou inaccessible. L’arrivée des réseaux sociaux et de leur massification vînt nourrir ce même récit anthropologique dans lequel cette fois, plus personne ne nous était inconnaissable ou inaccessible. Ce récit n’eût de sens et de réalité que dans une époque où les sites et les pages web se comptaient par dizaines de milliers et où la population connectée était de même ampleur. Mais même une fois cette époque révolue, ce grand récit anthropologique continua de vivre et d’entretenir à grands coups de marketing l’idée d’un monde numérique entièrement traversable … à la condition d’être entièrement personnalisable … et à la condition subséquente d’invariants de personnalisation postulants que nous aimerions toutes et tous les mêmes catégories de vidéos, les mêmes types de contenus plus ou moins polarisés ou tout à fait “anodins”, bref, que nous verrions tous du “même” en nous berçant de l’illusion d’une différence. La nature de ce “même” qui s’articule sur un phénomène trivial de viralité statistique analysable (correspondant à trois paramètres : un niveau de visibilité, une vitesse de circulation et une accélération de partages) contribue in fine à saturer l’espace du visible dissemblable.

Avec comme résultat ce que appelait une récente tribune dans The Atlantic : “Nobody Knows What’s Happening Online Anymore.”

Cette confusion est une caractéristique de l’internet fragmenté, qui peut donner l’impression que deux phénomènes opposés se produisent simultanément : Le contenu populaire est consommé à une échelle stupéfiante, mais la popularité et même la célébrité semblent miniaturisées, cloisonnées. Nous vivons dans un monde où il est plus facile que jamais d’ignorer totalement ce que les autres consomment. Il est également plus facile que jamais d’accorder une importance démesurée à des informations ou à des tendances qui peuvent sembler populaires mais qui sont en réalité contenues.

Le meilleur collègue Marc Jahjah écrivait il y a quelques mois alors que nous toutes et tous traversions, une fois de plus tant d’énonciations contradictoires à propos de la guerre en Ukraine ou de celle à Gaza :

Toutes ces images, ces avis contradictoires, ces fragments, qui ne permettent même pas, une fois collectés, de reconstituer un puzzle, une compréhension cohérente du monde. Ma perception bouge tout le temps, la vôtre aussi : avons-nous encore un référent commun et stable ? C’est très perturbant, car même avec des ami•es, on ne sait plus très bien si on parle de la même réalité, comme nous avons tous l’air d’évoluer dans des provinces algorithmiques différentes (“Ah bon, tu as vu ça toi ?”). Notre système de coordonnées est en train de bouger si vite que nous ne savons plus avec qui nous sommes en présence, ni dans quel lieu nous évoluons réellement. Même nous parler devient non pas inutile mais impossible, si nous n’avons pas la même réalité à commenter. Ce sont des états proches de la “para-noia” (…) : non pas au sens psychiatrique, mais au sens que donnaient les Anciens à ce terme. Un changement si brusque des coordonnées, que les individus glissent vers un dangereux horizon. Dangereux, car si nous n’avons plus un référent à peu près commun, tout devient impossible : parler, agir, mais aussi ressentir. J’ai des ami•es qui ne sont même plus certain•es de ce qu’iels ressentent, comme personne n’a l’air d’être aligné sur leur référent. “Dis-moi que je ne suis pas fou, que tu as vu ce que j’ai vu, que lorsque tu l’as vu, tu as ressenti ce que j’ai ressenti, (…)” : c’est la manière dont je résumerai cette paranoïa collective, qui est peut-être notre référent commun.

Il y a bien sûr également, la part instrumentale de ces référents mouvants, la phrase d’Arendt que l’on répète jusqu’à l’affadir alors qu’elle n’a jamais pourtant été aussi juste, aussi précise et aussi circonstanciée qu’aujourd’hui :

Quand tout le monde vous ment en permanence, le résultat n’est pas que vous croyez ces mensonges mais que plus personne ne croit plus rien. Un peuple qui ne peut plus rien croire ne peut se faire une opinion. Il est privé non seulement de sa capacité d’agir mais aussi de sa capacité de penser et de juger. Et avec un tel peuple, vous pouvez faire ce que vous voulez.

Mais pour en revenir à la trivialité de nos biotopes numériques, si l’on parle souvent de la pratique du Shadow Banning il faudrait aussi s’interroger sur l’importance des phénomènes de “Shadow Scrolling” qui décrivent un environnement dans lequel nos défilements – qui sont déjà la part aliénante de ce que furent nos navigations – se font sur une infime minorité de contenus et dans l’ombre de contenus massivement masqués, évités, dissimulés, invisibilisés. De la même manière que “la valeur d’un réseau social n’est pas seulement définie par ceux qui sont dedans mais par ceux qui en sont exlcus” (Paul Saffo), ce que nous voyons aujourd’hui dans un média social se définit principalement par ce que l’on nous empêche de voir, soit par nécessité technique, soit par objectif commercial, soit par éditorialisation partisane et par choix politique ou idéologique.

Des partitions à l’autarcie.

Il y a très très très longtemps de cela, j’avais l’intuition que je décris aujourd’hui mais sans prendre le temps de la creuser vraiment. Celle “d’autarcithécaires” (par opposition aux “bibliothécaires”) c’est à dire des gens, une classe de gens, qui finiraient par n’avoir de rapport à l’information que sous forme autarcique ; une autarcie médiée par des outils calibrés pour la fabriquer (à l’époque, en 2006, c’étaient les moteurs de recherche personnalisables, aujourd’hui, en 2023 ce pourrait être, notamment, les (chat)GPT également “sur-mesure”). Cette autarcie informationnelle s’accompagne d’une autocratie d’éditocrates, figures uniques et omni-discourantes qui font reculer l’idée que l’information nécessite des médiations et des autorités diverses et plurielles pour pouvoir être autre chose que de la simple propagande.

Rappel des précisions que j’apportais en 2021 à ce concept “d’autarcithécaires” :

néologisme construit par opposition aux bibliothécaires et à leur mission d’augmenter et d’organiser, par accumulation, la somme des savoirs disponibles pour l’humanité toute entière. Derrière les “autarcithécaires” il y avait cette idée d’un stade ultime de la personnalisation / personnification de l’accès à l’information, à la culture, aux loisirs, aux autres, où chacun, dans une forme d’autarcie linguistique, culturelle, informationnelle, nourrie par les puissances prescriptrices des moteurs de recherche puis des médias sociaux, ne serait plus en capacité que de voir seul, que de s’informer seul toujours auprès des mêmes sources en circuit fermé. J’en avais certes l’intuition mais je ne mesurais pas à l’époque à quel point cette notion allait devenir absolument centrale, notamment dans la déclinaison de la “bulle de filtre” qu’Eli Pariser forgera en 2011, ou plus tard en 2015 (et plus radicalement aussi) dans le “Seuls ensemble” de Sherry Turkle. (…)

Entre la vision d’un tout algorithmique rigoriste qui nous enfermerait nécessairement (les bulles de filtre) et qui parviendrait à faire fi de toute forme de libre arbitre, et celle d’une sociabilité systématiquement empêchée (“seuls ensemble”) qui ne prendrait pas en compte les sociabilités nouvelles, déplacées, réelles, et tout aussi “authentiques” (cf les travaux de danah boyd notamment) je crois qu’il existe une “troisième voie” : celle d’un déterminisme technologique qui sans les contraindre entièrement, convoque et orchestre à la fois nos sociabilités et nos libres choix. Il s’agit d’une dynamique mais d’une dynamique que nous accompagnons et que nous instancions, et que d’une certaine manière nous “comodalisons“.

L’ensemble de ces partitions finit par fabriquer des dynamiques où nous nous départissons de cette forme de commun que permettaient des dynamiques de propagations pouvant s’appuyer sur des percolations entre des biotopes informationnels concurrents.

Pendant des années, l’expansion du web se fit selon un modèle fractal, on y retrouvait des contenus, des organisations, des collectifs, qui présentaient peu ou prou les mêmes formes, les mêmes dynamiques à différents niveaux d’échelle. Aujourd’hui l’expansion des médias sociaux se fait selon un mode de simple partition qui ne se soucie jamais des effets de répartition (et donc d’équité tant dans l’accès à certaines informations et contenus que dans les modalités même de cet accès).

Du fractal au brutal.

A l’orée des années 2000, Albert-László Barabási publiait dans Nature un article dans lequel il mesurait le diamètre du web, qui était alors de 19 liens. Il allait également poser les bases de la théorie des réseaux invariants d’échelle (le système n’a pas d’échelle caractéristique) :

Nous avons découvert que de nombreux réseaux (de la « Toile » Internet au métabolisme cellulaire, en passant par celui des acteurs de Hollywood) partagent des caractéristiques communes, notamment le fait qu’un nombre restreint de nœuds a un grand nombre de liaisons avec des nœuds peu connectés. Ainsi chaque « site » du réseau est soit un nœud assez isolé (peu connecté), soit un « supernœud » : aucun nœud n’est représentatif de l’ensemble. De tels réseaux, qui ont tous la propriété dite d’« invariance d’échelle », présentent des comportements prévisibles : par exemple, ils sont remarquablement résistants aux défaillances accidentelles, mais extrêmement vulnérables aux attaques concertées.

Depuis lors, la question même de mesurer le diamètre du web (et donc la possibilité de le traverser) ou des plateformes n’a plus été systématiquement explorée, en dehors de quelques communications lors de la conférence IMC (Internet Measurement Conference) de l’ACM mais qui s’intéressent davantage à des dynamiques techniques plutôt que sociales.

Si ce n’est plus un enjeu que d’être capable de mesurer de combien de liens les contenus disponibles sont séparés à l’échelle d’écosystèmes informationnels massifs comme le web ou les médias sociaux, c’est entre autre précisément parce qu’au sein des médias sociaux nous ne créons que très peu de liens (cf le like tuera le lien) et que l’essentiel des usages et des partages se concentrent au sein de “supernoeuds” qui concentrent l’essentiel des interactions en ligne. Très peu de contenus ou de biotopes informationnels et très peu d’individus (super utilisateurs ou “power users”) qui déterminent et guident l’ensemble des dynamiques de propagation des médias.

Barabasi encore :

Notre connaissance des réseaux invariants d’échelle nous aide à comprendre la propagation des virus informatiques, des maladies ou encore des modes. Les théories de la diffusion et de la percolation, étudiées pendant des décennies par les épidémiologistes et par les analystes des marchés, prédisent l’existence d’un seuil critique pour la propagation d’une épidémie dans une population donnée : tout virus dont le degré de contagiosité est inférieur à un seuil critique finit par disparaître. Au-dessus du seuil critique, le virus se développe exponentiellement, infectant toute la population.

Romualdo Pastor-Satorras, de l’Université polytechnique de Barcelone, et Allessandro Vespigniani, du Centre de physique théorique de Trieste, ont récemment établi un résultat inquiétant : ils ont montré que dans un réseau invariant d’échelle le seuil est nul. Ainsi, tous les virus, même les virus peu contagieux, se propagent dans la population et y perdurent. Comme les supernœuds sont reliés à une grande quantité de nœuds, au moins l’un d’eux risque d’être infecté par un nœud contaminé. Quand ce supernœud est atteint, il contamine une multitude d’autres sites, et met en danger d’autres supernœuds, qui finissent par diffuser le virus dans tout le réseau.

Ces supernoeuds sont aujourd’hui l’essence à la fois technique, infrastructurelle mais également sociale de nos interactions et de notre rapport aux médias et à l’information (avec des exceptions notables comme Mastodon ou Peertube et la galaxie de service offerte et défendu par – par exemple – Framasoft). Ils sont la clé de ces partitions et de la densité des opinions et des polarisations qu’elles instancient de manière très brutale.

Le fractal à pour ainsi dire laissé la place à une forme de … brutal.

Et pour le reste, laissons à Latour le dernier mot : “Cela a toujours été des questions d’occupation de territoires, et de déplacements.”

]]>

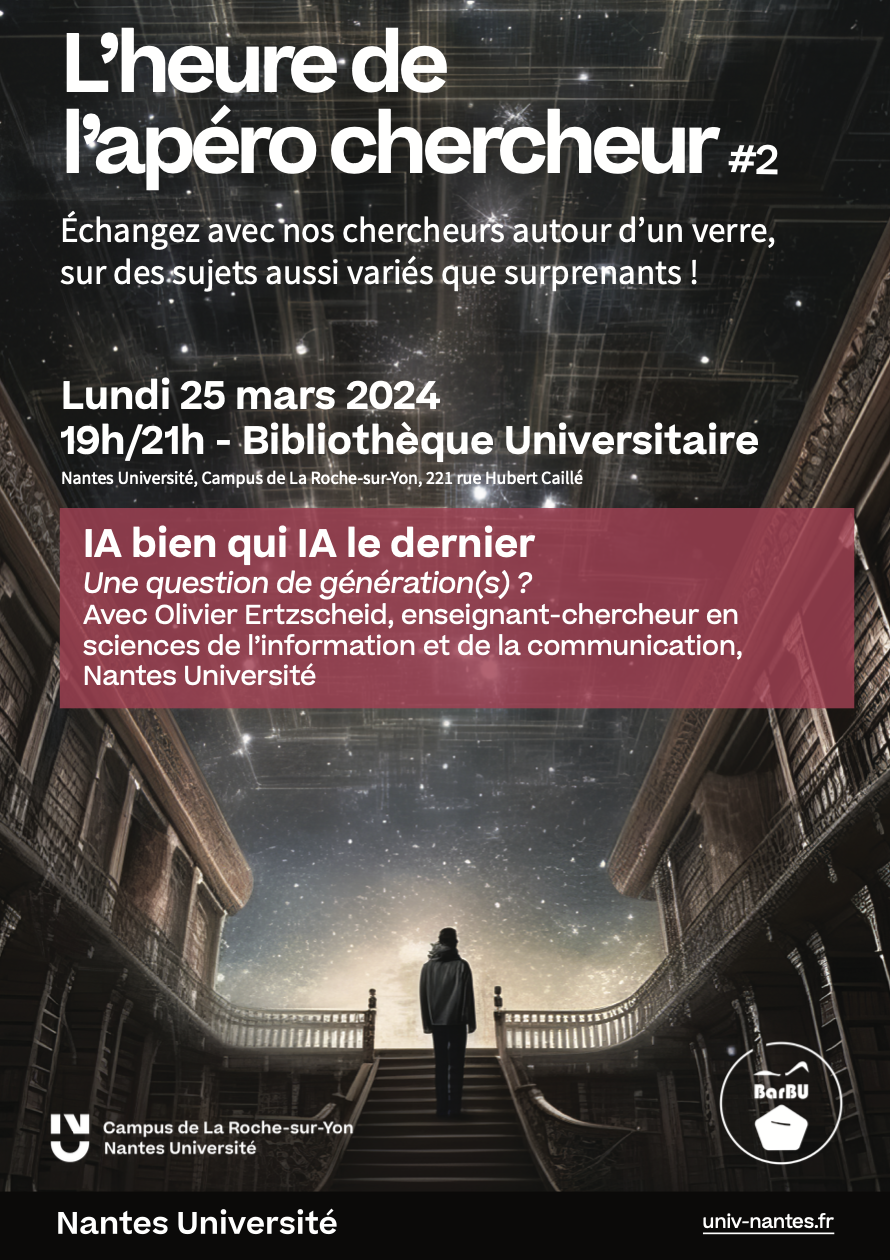

: “Nantes Université suspend toute activité sur le réseau X. Nantes Université tire ainsi les conséquences d’une profonde évolution éditoriale du réseau X qui a fait le choix de se retirer du code européen des bonnes pratiques contre la désinformation et a modifié ses règles de modération. Engagée pour mettre le progrès scientifique et l’innovation au service de la société, profondément attachée à la démocratie, Nantes Université défend des valeurs de tolérance, d’humanisme et d’universalisme incompatibles avec la dérive de ce réseau. Vous pouvez continuer à suivre nos actualités sur Instragram, Linkedin, Facebook et sur notre site web.”

: “Nantes Université suspend toute activité sur le réseau X. Nantes Université tire ainsi les conséquences d’une profonde évolution éditoriale du réseau X qui a fait le choix de se retirer du code européen des bonnes pratiques contre la désinformation et a modifié ses règles de modération. Engagée pour mettre le progrès scientifique et l’innovation au service de la société, profondément attachée à la démocratie, Nantes Université défend des valeurs de tolérance, d’humanisme et d’universalisme incompatibles avec la dérive de ce réseau. Vous pouvez continuer à suivre nos actualités sur Instragram, Linkedin, Facebook et sur notre site web.”